Alan Turing, pionnier de l’intelligence artificielle, a écrit en 1950 un article : Computing Machinery, qui lui a valu ce statut. Il a également créé le test de Turing, permettant de qualifier une machine de « consciente ». Selon lui, l’intelligence d’une machine se définit par sa capacité à atteindre un niveau « humain » de performance dans des tâches cognitives. Aujourd’hui, chaque année le prix Turing est décerné comme récompense en informatique en son honneur. C’est en quelque sorte le prix Nobel de l’informatique. Cette année 2019, le prix Turing fut décerné à un groupe composé de trois chercheurs (le britannique Geoffrey Hinton, le canadien Yoshua Bengio et le français Yann LeCun) pour leurs recherches sur le Deep Learning depuis 1970, aboutissant aujourd’hui à poser les bases de ce concept (cf. C. Bichler, « Le prix Turing : Le français Yann Lecun couronné avec deux autres pionniers de l’intelligence artificielle », 2019).

Selon Alan Turing, l’intelligence artificielle est la capacité d’une machine à reproduire une forme d’intelligence, à être capable de traiter des problèmes basiques, ou plus complexes selon une situation donnée, selon le degré de difficulté de la tâche lui étant attribuée. L’IA voit réellement le jour en 1956 lors de la conférence de Dartmouth, puis elle subit une certaine mutation dans les années 2000 avec l’arrivée d’internet. L’IA est alors plus pragmatique, bio inspirée (elle tend plus à se rapprocher de la nature, à copier des systèmes d’êtres vivants plus ou moins complexes tels que les réseaux neuronaux). On parle aujourd’hui de cerveau dit de silicium (composé de composants électroniques) et de cerveau biologique (humain). C’est alors ici qu’entre en jeu une sorte de « guerre dichotomique », tendant à s’avérer ou non, entre intelligence humaine (IH) et intelligence artificielle (IA). En effet, le fait que cette IA tende à se rapprocher de la complexité du cerveau humain à l’image des réseaux neuronaux le constituant vient poser une question fondamentale : à terme, l’IA viendra-t-elle remplacer ou non l’IH, ou ces deux formes d’intelligences seront elles connexes, complémentaires ?

Nous aborderons le sujet dans un premier temps en analysant les différents types d’intelligences, puis nous mettrons en lumière plusieurs communautés, ayant des points de vue divergeant sur une IA que nous pouvons décliner en plusieurs niveaux (I), puis nous verrons ce qu’il en est de la création de valeur et la prise de décision (II).

I. Les communautés dans l’intelligence artificielle et les différents niveaux d’intelligences

A. De quel type d’intelligence parlons-nous ?

Ce qui différencie aujourd’hui l’IA de l’IH réside dans la dimension humaine que cette IH implique : capacité d’empathie, d’émotion, d’intuition… chose impossible dans l’état actuel des choses pour un cerveau de silicium. En effet, l’IA est purement rationnelle. On parle d’ailleurs d’intelligence rationnelle.

L’intelligence rationnelle : comme nous l’avons vu, l’être humain peut être en proie à divers éléments pouvant affecter son jugement (empathie, émotion…), et la capacité de traitement du cerveau humain reste limité quand il a affaire à une masse de donnée trop importante (2,5 Pétaoctets selon les scientifiques). L’IA la plus avancée est désormais plus rationnelle que l’être humain, plus « raisonnable » (Olaf de Hemmer Gudme, « IA, IH ou IHA : de l’artificiel pour plus ou moins d’humain ? », 2017).

L’intelligence systémique : la pensée cartésienne naissant au XVIIe siècle nous dit de « bien mener sa raison » en suivant le « discours de la méthode » reposant sur quatre principes : évidence, analyse, causalité et exhaustivité. L’on sépare ici la raison de la spiritualité. Mais où est le sens ? Ainsi, les préceptes induis par Rabelais au XVIe siècle reviennent sur le devant de la scène : « science sans conscience n’est que ruine de l’âme ». Nous voilà ici dans une impasse semble-t-il… En effet, Descartes nous propose ici une recherche de causalité sur des faits antérieurs, passés, et l’intelligence systémique elle s’appuie sur la finalité à atteindre, la recherche d’un but en corrélation avec l’environnement, utile à un ensemble futur, à venir. On parle ici de système (Joël de Rosnay, « Un système est un ensemble d’éléments en interaction dynamique, organisé en fonction d’un but »). Mais cette notion organisationnelle en « fonction d’un but » ne calque pas vraiment aux systèmes sociaux, induisant une pluralité de buts souvent contradictoires (cf. Karl E. Weick). Nous pourrions parler ici d’un changement de paradigme, mais en réalité les deux sont connexes, avec un raisonnement cartésien cherchant à comprendre, et un raisonnement systémique visant à améliorer. Certes, l’IA permet de raisonner à la manière de Descartes, mais lui est-il possible de raisonner de manière systémique ? Une machine peut-elle déterminer elle-même des buts quand bien même un être humain ne peut le faire que pour sa propre personne ? Il semble donc que la machine se doit d’être couplée à l’humain… A moins que celle-ci puisse être « auto-finalisée », à la manière d’Elon Musk…

L’intelligence collective : c’est la collaboration d’un groupe, d’un ensemble d’individus (que l’on pourrait étendre à un ensemble d’individus/machine à l’avenir…) permettant la mise en commun de connaissances, d’intelligences pour arriver à un tout supérieur à la somme des parties. Il semble en effet aisé et rationnel de confier à une IA des tâches répétitives, mais il semble nettement moins sensé de confier l’ensemble des tâches uniquement à une IA. En effet, « comment définir et réaliser l’utilité de ces tâches sans humains » (Hamza Didaraly, 2017) ?

B. Les différentes communautés

En 2017, dans son livre : “ La guerre de l’intelligence ” ‘, le Dr Laurent Alexandre a défendu la thèse d’une intelligence artificielle faisant des progrès gigantesques et changeant profondément le monde de la justice, de l’emploi, de l’économie et de la politique d’ici quelques décennies.

En effet, prenons l’exemple des robots chirurgiens qui pourraient conduire à des percées majeures dans les techniques médicales. L’intelligence humaine et biologique du chirurgien classique est donc remise en cause, la chirurgie étant l’un des domaines complexes de nos sociétés actuelles. Les possibilités sont nombreuses et nous donnent l’occasion de réfléchir, à travers la question de l’intelligence, sur la spécificité et l’avenir de l’humanité.

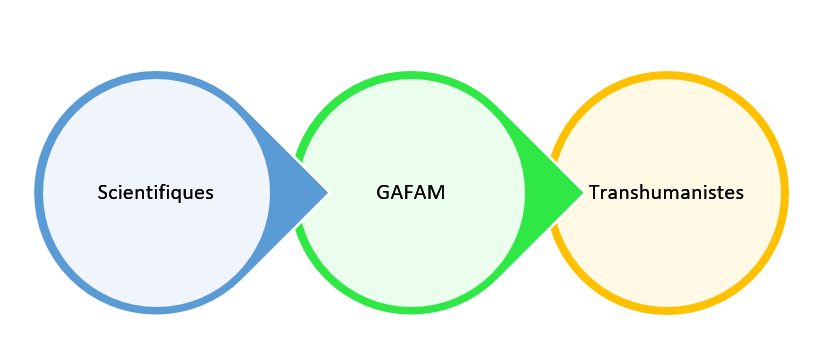

On peut remarquer en analysant différents articles, travaux et études, qu’il existe 3 communautés distinctes, avec des points de vue divergents :

-La première communauté est celle des scientifiques qui perçoivent l’émergence de l’IA comme un concurrent en mesure de dépasser l’intelligence humaine voire de la réduire en esclavage.

Ainsi, pour le Dr Laurent Alexandre, la révolution des NBIC (nanotechnologies, biotechnologies, informatique et sciences cognitives) est un signe ouvrant des perspectives extraordinaires mais dangereuses. Pour lui, l’intelligence artificielle est une menace pour l’homme si deux conditions sont réunies : L’IA doit être plus efficace que l’intelligence humaine et d’autre part l’IA doit être consciente de sa supériorité (avec pouvoir de décision, autonomie, conscience). La première condition semble être remplie car « le neurone perd chaque jour plus de points devant le transistor dans la course à la productivité et à l’efficacité ». En effet, la vitesse et l’infaillibilité des machines » ; l’exécution est de nature à faire travailler l’homme. Nous n’avons jamais vu un cheval se battre contre un TGV.

Le physicien Stephen Hawking, théoricien de l’expansion de l’univers et auteur de nombreux ouvrages scientifiques très populaires, craignait que les humains, limités par une lente évolution biologique, ne puissent rivaliser avec l’intelligence artificielle. De plus, il estimait que l’intelligence artificielle pourrait mettre un terme à l’humanité et mettait en garde contre son développement.

Elon Musk, fondateur de Tesla et SpaceX, qui alimente les plans de colonisation de Mars, demande que des mesures de sécurité soient prises contre la menace potentielle posée par l’IA. Selon lui, l’intelligence artificielle est désormais “le plus grand risque auquel notre civilisation sera un jour confrontée » ; Il prédit qu’il sera déjà trop tard pour sauver l’humanité si l’homme ne prend pas des mesures drastiques aujourd’hui face à cette technologie toute puissante.

Eric Sadin, dans une interview accordée à YouTube (ThinkerView) le 08/11/2019 sur divers sujets d’actualité, nous fait des révélations, citant l’exemple de l’application Waze, rachetée par Google en 2005-2006, qui décrit en temps réel la situation du trafic et recommande de prendre un itinéraire plutôt qu’un autre. Le libre exercice de notre jugement est progressivement remplacé par des systèmes destinés à influencer nos décisions, principalement pour répondre à des intérêts privés. Il s’agit d’une rupture juridico-politique majeure.

– D’un autre côté, nous avons la communauté GAFAM qui ne jure que par l’intelligence artificielle.

Par exemple, le patron de Facebook, Mark Zuckerberg, estime que « nous pouvons créer des choses pour rendre le monde meilleur », en citant des exemples tels que la réduction des accidents de la route avec des voitures autonomes. Dans une interview sur CNN le 25 juillet 2017, il a avoué qu’il n’était pas d’accord avec ceux qui voulaient ralentir les progrès et considérait cela comme une attitude « irresponsable ».

– La troisième communauté réunissant fans de science-fiction, transhumanistes et rêveurs d’un nouveau monde.

Nous pouvons prendre l’exemple du nouveau robot Atlas de Boston Dynamics, une filiale de Google qui est incroyablement agile. Equipé d’IA, Atlas sera le meilleur travailleur du monde, le meilleur manutentionnaire en 2020.

Cependant, lorsque nous entendons la plupart des grandes entreprises ou des scientifiques parler, nous parlons davantage de puissance de calcul et la notion d’intelligence est rapidement restreinte ! Il semble important de replacer les choses dans leur contexte et de comprendre que des opinions différentes sont ancrées dans différentes questions et perceptions du monde.

En effet, la communauté scientifique s’inquiète de l’IA car elle la perçoit comme un danger susceptible d’être détourné par l’homme, alors que l’IH n’a pas encore fini de nous montrer tout son potentiel. De plus, l’intelligence artificielle n’est finalement qu’une bulle spéculative sur lequel beaucoup misent gros. Les attentes seront-elles à la hauteur des espérances ?

Les GAFAM eux-mêmes, avec un empire puissant et un capital inimaginable, investissent des milliards car ils connaissent les possibilités : monopole, rentabilité, pouvoir, etc. Ainsi, on observe que Mark Zuckerberg, à qui sont attribuées des ambitions personnelles pour les élections américaines de 2020, a également précisé que l’intelligence artificielle pourrait avoir son rôle à jouer dans la construction d’un futur système américain de sécurité sociale. Le milliardaire, actuellement en tournée dans divers États américains, imagine un modèle de santé intelligent qui offre de meilleurs diagnostics et traitements.

Cependant, en 2019, un événement s’est produit, ayant changé la vision de certaines personnes : l’IA a vaincu le jeu de go.

La victoire d’Alphago est en fait une victoire plus globale. C’est aussi une victoire pour Lee Sedol, le précédent champion. Cela a aidé le champion à mieux comprendre la complexité du jeu de Go et lui a ouvert de nouvelles voies. Et cette « innovation » est le résultat d’une histoire partagée. AlphaGo a provoqué une nouvelle attitude chez Lee, qui a poussé la machine à ses limites et l’a poussée à enfreindre les règles. En fin de compte, tout le monde a appris quelque chose. Lee Sedol s’est amélioré en affrontant la machine, de manière très rationnelle et émotionnelle.

C. Les différents niveaux d’intelligence artificielle

IA « forte », IA « faible » … Voilà qui paraît quelque peu réducteur. En ce sens, Heudin Jean-Claude, dans son ouvrage « Intelligence artificielle. Manuel de survie » (2017), va proposer plusieurs niveaux d’IA :

- Le niveau 1 : sous-humain pour des tâches spécifiques : l’on parle ici d’une entité algorithmique (application, composant logiciel…) permettant d’effectuer une tâche spécifique simple mais globalement de manière moins performante qu’un être humain. C’est le cas par exemple des chatbots ou encore des systèmes de reconnaissance vocale, où l’humain est encore aujourd’hui bien plus efficace en termes de rendu.

- Le niveau 2 : équivalent à un humain pour des tâches spécifiques : le résultat atteint par l’algorithme est ici égal à celui de l’humain pour une tâche spécifique. On parle ici par exemple d’un système capable d’identifier et de classer des images en quantité limitée et peu dynamiques.

- Le niveau 3 : supérieur à la plupart des humains pour des tâches spécifiques : ici, l’algorithme dépasse l’être humain dans une tâche spécifique, mais il est toujours possible qu’une personne spécialisée puisse atteindre de meilleurs résultats. Un exemple est celui de Deep Blue (IBM) en 1990 qui égalait les meilleurs joueurs d’échec.

- Le niveau 4 : supérieur à toute intelligence humaine pour des tâches spécifiques : cette fois, l’entité algorithmique dépasse l’être humain pour une tâche spécifique. Alpha Go est ici un exemple de ce type d’IA, battant les meilleurs joueurs mondiaux au jeu de go.

- Le niveau 5 : égale ou supérieure à l’IH pour une majorité de tâches : il n’existe à ce jour aucune IA capable d’une telle prouesse. L’idée est ici que l’IA serait égale ou supérieure à l’humain dans une multiplicité de tâches. On parle ici d’une dimension transversale des tâches pouvant être effectuées. C’est ici qu’apparaît le terme d’IA « forte ». Un tel niveau de complexité semble être difficilement atteignable, même sur un horizon prochain.

- Dernier niveau, le niveau 6 : intelligence artificielle ultime (singularité technologique) : l’entité algorithmique est ici largement supérieure à l’intelligence humaine dans n’importe quelle tâche. On parle d’intelligence ultime ou « singularité technologique ». L’hypothèse d’un tel niveau de complexité fut largement décriée par les nombreux scientifiques sur le sujet, ce qui parait très peu probable, voire inatteignable.

Certes, dans un monde certain, restreint à un monde de données propres à chaque secteur, une IA reste bien plus performante qu’un cerveau humain pour des tâches spécifiques, mais dans un monde plus large tel que le nôtre, incertain, où l’environnement est à prendre en compte, où la transversalité des tâches est nécessaire et où il faut constamment s’adapter, il est difficilement imaginable qu’une IA surpuissante puisse dominer et avoir conscience de tout ce qui l’entoure sans qu’une action humaine ne vienne la compléter. Ce problème de conscience de la machine est d’ailleurs abordé par Mr. Heudin, nous disant que l’être humain est un être conscient, pas la machine. Le cerveau humain, connecté à son propre corps est lui-même le fait d’une « coévolution et de développement dans l’environnement. Cette relation à notre corps, au monde qui nous entoure est naturelle. Nous sommes des êtres conscients ».

Tout ce côté émotionnel, cette empathie, cette capacité à aimer/détester, notre intuition… nous différencie de la machine, calculatrice et fondamentalement rationnelle, mais surtout basé sur des faits passés voire présents pour en prédire l’avenir semble discutable. En effet, tout ceci ne calque pas avec la physique traditionnelle de Newton, avec ce paradigme dans lequel nous sommes formés intégrant tous les liens de causalité. Une machine aurait-elle pu créer l’électricité, prédire son arrivée et toutes les révolutions qu’elle a engendré ? Une IA aurait-elle pu, à la manière de Da Vinci mettre en cohérence des éléments improbables comme la mythologie et le réel pour créer des inventions ?

II. L’intelligence humaine, une source inépuisable de développement et une complémentarité avec l’intelligence artificielle

A. S’adapter : Le mot clé

En temps de crise, il faut pouvoir prendre du recul et se poser les bonnes questions, car comme le disait Alfred Sauvy dans son livre ‘’Théorie générale de la population : ” « Despote conquérant, le progrès technique ne souffre pas l’arrêt. Tout ralentissement équivalent à un recul, l’humanité est condamnée au progrès à perpétuité. »

Dans la première partie, nous avons parlé du fait que l’IA est perçue comme une menace car elle fait tout plus vite que nous. Pourtant, comme le Dr Alexandre l’écrit : ” l’IA pourrait devenir supérieure à l’humanité “, pour qui elle prend l’apparence d’un “crépuscule”.

Ce qui fait la supériorité actuelle de l’humanité, c’est l’existence d’un conscient. Même s’ils ne sont pas toujours bons, les êtres humains sont capables de faire des choix, de fixer des objectifs et de remettre en question leur valeur. Par ailleurs, comme le psychologue Olivier Houdé, spécialiste du développement de l’intelligence infantile, a précisé dans un entretien à Sciences et Avenir que les algorithmes ne sont qu’une COMPOSANTE de l’intelligence.

Les machines ont des capacités hors normes dans des activités très spécialisées. Mais la question est : pouvons-nous apprendre aux machines à se spécialiser sur dans des domaines pour lesquels elles ne sont pas programmées ? Comme jouer à plusieurs jeux différents ou acquérir ce qu’on appelle très vulgairement le bon sens. Nous avons un peu de mal à penser qu’une machine, même très sophistiquée, dopée au Deep Learning, puisse acquérir une conscience d’elle-même. Une machine pourrait-elle savoir qu’elle est une machine ? Nous ne le pensons pas, à moins que les humains ne soient conscients d’eux-mêmes que grâce à un algorithme dont ils ignorent l’existence…

Ce qui est intéressant avec les machines, c’est cette sorte d’effet miroir qu’elles opèrent : elles nous obligent à nous poser des questions sur nous-mêmes, sur nos actions mais aussi sur notre façon de penser.

Alors maintenant que nous savons que l’IA ne sera jamais l’équivalent de l’IH et afin de poser les bonnes questions, ne devrions-nous pas plutôt parler de la complémentarité qui peut exister entre IA et IH ?

En effet, quand on regarde les débats actuels autour de l’IA, il y a une forme de fatalisme : l’Homme doit s’adapter ou il disparaîtra.

Un tel fatalisme est surprenant dans un contexte où l’intelligence artificielle est une technologie inventée et déployée à grande échelle par l’homme lui-même. Et si on déplaçait le prisme du débat pour questionner la complémentarité de la machine à l’Homme ? N’est-ce pas cette complémentarité potentielle qui donne à l’Intelligence Artificielle sa vraie valeur ajoutée ? L’homme n’a-t-il pas le pouvoir de concevoir un avenir pour l’intelligence artificielle et ses emplois dans la société d’aujourd’hui et de demain ?

Lors d’une conférence donnée par Alexandre Cadain le 12 juillet 2017, le jeune Entrepreneur et Ambassadeur d’IBM Watson AI Xprize, qui a lancé le projet Anima.ai, a parlé de ce qu’est une machine qui complète l’Homme.

Il dit : “C’est une machine qui fait ce que l’homme ne fait pas maintenant et n’a pas la capacité de faire”.

Par exemple, la révolution numérique a créé un chaos d’information dont il est désormais difficile d’extraire des connaissances. L’Homme est perdu dans le flux constant d’informations. L’intelligence artificielle pourrait être davantage utilisée pour ordonner ce chaos et exploiter le potentiel de ces informations. Cadain prend ainsi l’exemple du jeu Minecraft sur lequel des millions de joueurs construisent et entretiennent des mondes virtuels ; tous les jours. Pourquoi ne pas créer une IA capable de détecter les solutions innovantes créées par les acteurs afin d’exploiter le potentiel de ces solutions dans le monde réel ? Bref, il s’agirait d’augmenter le potentiel de l’Homme à travers la machine plutôt que d’augmenter le potentiel de la machine contre l’Homme.

B. Qu’en est-il de la création de valeur, de la détermination du besoin

Une IA peut-elle créer de la valeur d’elle-même ? Peut-elle répondre à une attente sous-jacente non exprimée et future ? Olaf de Hemmer Gudme, conseiller en création de valeur et spécialiste de l’approche systémique illustre avec un exemple très intéressant ce problème rencontré par l’IA en utilisant le conte pour enfant « Le Petit Prince » de Saint-Exupéry.

Dans le conte, le petit prince vient à la rencontre de l’aviateur en panne en lui demandant : « dessine-moi un mouton ». Une intelligence artificielle aurait très bien pu le faire, réglant ainsi le problème (si bien sur cette dernière avait une image de mouton dans sa base de données), l’aviateur étant très mauvais en dessin. Mais l’aviateur a une intuition et dessine alors une boîte, disant au petit prince que le mouton est dedans, ce qui lui va parfaitement. Il y a ici une réelle disruption du mouton, on ne répond pas exactement à la demande, on met moins de ressources pour y parvenir, et ceci convient au « client ». Olaf de Hemmer Gudme met ici en avant un raisonnement reposant sur deux questions : à quoi sert le mouton ? Et qu’est ce qui suffit pour répondre à quoi il sert ? Le raisonnement est ici de de poser la question à celui qui sait. Le raisonnement selon lui qui permet de donner la boîte à la place du mouton ne peut pas être fait par une IA, car la seule personne qui sait est le petit prince. Le problème serait ici pour l’IA de retrouver le petit prince dans ses données, mais ses besoins seront ici complétement changés car l’humain évolue et ses besoins avec lui. En effet, l’IA est fondée sur des pratiques passées, cristallisées : ce serait donc une analyse prédictive fondée sur le passé, une des limites de l’IA comme nous l’avons vu plus haut.

Pour illustrer, prenons un vendeur/annonceur type Amazon : la plateforme va nous proposer un bien en fonction des recherches passées. Prenons un manteau acheté à un instant t. En t+1, Amazon va proposer un manteau dans le même style que celui acheté précédemment, un peu différent, peut-être plus grand s’il prend en compte la temporalité… Mais le risque est que les besoins de la personne aient complètement changé, le mieux est alors de le demander directement à la personne. En ce sens, une IH serait plus efficace qu’une IA en termes de rationalité car l’IH va prendre en compte tout un ensemble d’élément et sera plus à même de comprendre le besoin exprimé.

Pour en revenir à nos moutons, plus loin dans l’histoire l’on apprend qu’il y a une rose qui ne doit pas être mangé, il faut donc une muselière au mouton, que l’aviateur lui propose, et un contenant pour embarquer tout ça sur sa planète : la boîte ! Donc le besoin de l’élément improbable qu’est la boîte devient alors une évidence. Tous ces nouveaux besoins naissent alors de l’interaction des parties, les objectifs, les besoins doivent donc être mis dans la machine (l’IA), dans la boîte par une IH. La disruption est fondamentale et doit être prise en compte, chose qu’une intelligence artificielle n’est pas en capacité de faire car elle viendrait chambouler tout son modèle.

En somme, l’intelligence rationnelle dont fait preuve l’IA est basée sur le passé et le présent selon le raisonnement cartésien, puis la finalité et le but sortent de ce raisonnement cartésien : le raisonnement systémique, c’est le besoin d’un Homme pour un Homme, et ceci ne peut pas être pris en compte par la machine.

C. Intuition et prise de décision

Dans son raisonnement rationnel, une intelligence artificielle donnerait des prédictions et donc une marche à suivre selon des modèles passés, basés sur les données alimentant son algorithme. Seulement voilà, les plus grands chefs d’entreprises, les multiples penseurs attribuent un poids fondamental à l’intuition, ne pouvant être atteint par une IA (sauf agrégation de nouvelles données disruptives émanant d’une IH, donc une IA en retard sur l’avenir, bien que sa fonction soit prédictive).

En effet, Tim Cook, dirigeant d’Apple, nous dit lors d’un interview être ingénieur, donc fondamentalement rationnel. Mais il nous livre également que c’est son intuition qui fait ses prises de décision, et non pas sa rationalité (étant la forme d’intelligence d’une IA). Au même titre, les ingénieurs et innovateurs de la Silicon Valley utilisent ce type d’intelligence systémique, en prenant en compte leur environnement, la culture, les changements qui s’opèrent…

Daniel Kahneman, prix Nobel en économie, met en valeur dans son ouvrage « Thinking fast and slow » l’importance de l’intuition et combien elle apporte. Elle permet, selon ses, dires d’être plus rapide, plus fiable, plus précis tout en mobilisant moins d’efforts par rapport à la rationalité.

André Gessalin, expert en intuition, met en avant un exemple lors d’un interview vidéo (« IA VS IH », 2017) dans le monde de la bourse : les plus performants sont ceux qui se fient à leur intuition, et ne sont pas les plus rationnels, cela étant jugé trop complexe. Pour illustrer ce propos, prenons Warren Buffet, un géant dans la spéculation boursière, étant qualifié « d’Oracle d’Homaha » pour sa capacité à prédire les variations en se fiant à son intuition et sa capacité de jugement mêlant toutes les variables en un ensemble cohérant. Un peu comme les systèmes chaotiques décrits par Wolfram Stephen (« Univeraslity and complexity in Cellular Automata », 1984), il n’y a pas de cycles définis, les cycles n’ont pas de rapport de causalité car n’ayant pas de liens entre eux. L’IA ne va pas pouvoir définir quelque chose de précis, récurrents, alors que l’IH a la capacité de faire de nouveaux cycles, en analysant son environnement, et en en créant un nouveau, alimentant les futurs algorithmes. Même les cycles de quatrième classe jugés complexes ne peuvent pas le faire car étant calqués eux aussi sur des modèles passés. Selon A. Gessalin, l’intuition c’est la « mise en cohérence d’éléments disparates en un tout réunifié et simplifié ». C’est cette transversalité, cette mise en cohérence d’éléments disparates qui n’est, tout du moins à ce jour, pas possible pour les IA actuelles.

Afin de dynamiser l’IA, il convient de se focaliser sur ce qu’elle ne peut pas faire plutôt que sur ce qu’elle peut faire : empathie, amour, intuition… et c’est ce qu’ont fait les data scientist et experts en IA : selon eux, l’IA est fondée sur le passé et parfois le présent. Le problème est que nous sommes dans un monde incertain, complexe et donc en proie à l’incertitude, ce qui ne convient pas à une IA (André Gessalin, 2017). Jack Ma également vient renforcer ces propos (président d’Alibaba group) : « pour réussir il faut du QI, du quotient intellectuel, mais dans le futur de l’amour. Il faut identifier ce que les machines ne peuvent pas faire ».

Il convient d’aller vers le futur. Un décideur intuitif aura de l’avance sur un reporting car il aura suivi son intuition, son ressenti en cohérence avec son environnement, ses moyens et ses contraintes, c’est pourquoi une intelligence artificielle ne peut pas remplacer l’intelligence humaine. En revanche, elle peut venir aider à la prise de décision en fournissant une aide supplémentaire et compétitive sur des questions rationnelles couplées à l’intelligence systémique humaine.

Conclusion

Notre culture occidentale, étant basée sur les fondements de la pensée platonicienne et cartésienne induisent une forte dichotomie/dualité : l’Homme opposé à la Nature, l’Esprit opposé à la Matière…

Il paraît alors logique dans cette même continuité d’opposer l’IH à l’IA, et toujours dans le même esprit que l’une remplace à terme l’autre. Mais, au même titre que l’Homme et la Nature, ou l’Esprit et la Matière, l’un n’a pas remplacé l’autre mais cohabite. Bien sûr, l’Homme tend à dominer la Nature et donc la matière, mais l’un ne va pas sans l’autre. En effet, sans nature il n’y a pas d’Homme, et l’esprit doit avoir de la matière pour fonctionner.

La finalité veut que ce soit l’Homme qui soit au centre, et non l’autre partie prenante. Il semble illusoire et même improbable que l’IA prenne le pied sur l’IH, l’Homme ayant vocation à dominer. En effet, et comme nous avons pu le voir, l’IA est très différente de l’IH. Sur certaines tâches spécifiques et rationnelles, l’IA peut s’avérer très performante, allant jusqu’à dépasser l’humain dans le traitement de données massives, toutefois, il convient d’appréhender le monde dans sa globalité et toute sa complexité, et pour ce faire, le cerveau biologique, l’IH, reste inégalée.

L’une ne vient donc pas remplacer l’autre, mais les deux se complètent : grâce à tout ce que l’IA peut apporter, que ce soit en capacité de traitement, d’analyse… Tout ceci vient permettre au cerveau humain d’être stimulé et épaulé, et non pas remplacé. La nature fondamentale de l’être humain est de dominer et non l’inverse, en ce sens il est très difficilement concevable que la machine remplace l’Homme dans son ensemble, mais plutôt qu’elle lui permette d’atteindre un stade supérieur, comme le revendique Jack Ma, président d’Alibaba Group : « l’IA vient se coupler à l’humain, pour passer du faire, à l’avoir, pour atteindre l’être ».

Aussi, les multiples problèmes auxquels nous sommes confrontés actuellement semblent sans réelles réponses: conflits, réchauffement climatique, catastrophes naturelles, raréfaction des ressources… Il convient donc de faire converger toutes les formes d’intelligence en un ensemble commun et cohérant pour faire face aux défis actuels, à l’image de la mise en réseaux que prône l’intelligence économique. Un exemple de cette cohabitation entre IH et IA le plus extrême et portant à controverse est celui de la société Neuralink fondée par Elon Musk, travaillant sur des implants neuronaux visant à marier le cerveau biologique au cerveau de silicium en permettant à l’Homme d’interagir directement avec la machine via les ondes cérébrales. Testé sur les chimpanzés, les tests sur l’Homme doivent voir le jour au fil de cette année 2020. L’enjeu est ici de réussir à contrôler les possibles dérives de tels systèmes.

Par Marvin Emery et Sylman Teulieres, promotion 2019-2020 du M2 IESCI

Bibliographie

Ouvrages :

- Bichler, « Le prix Turing : Le français Yann Lecun couronné avec deux autres pionniers de l’intelligence artificielle », 2019

- Alexandre, « la guerre des intelligence – intelligence artificielle versus intelligence humaine », 2017

Daniel Kahneman, « Thinking fast and slow », 2012

Olaf de Hemmer Gudme, « IA, IH ou IHA : de l’artificiel pour plus ou moins d’humain ? », 2017

Heudin Jean-Claude, « Intelligence artificielle. Manuel de survie », 2017.

Heudin Jean-Claude, « Immortalité numérique. Intelligence artificielle et transcendance », 2014.

Wolfram Stephen, « Universality and Complexity in Cellular Automata », 1984

Turing Alan M., « Computing Machinery and Intelligence », 1950

George Orwell, «1984 », 1972

Samuel Huntington, « Le choc des civilisations », 1996

Laurent Alexandre, « La guerre des intelligences », 2017

Liens :

https://www.cairn.info/revue-futuribles-2019-1-page-93.htm#no18

http://valeursetmanagement.com/ia-ih-ou-iha-de-lartificiel-pour-plus-ou-moins-dhumain/

https://www.facebook.com/nwow.fr/videos/540389076295632

https://www.youtube.com/watch?v=jMaXkXww4Q0

http://www.cefro.pro/archive/2017/11/11/le-cerveau-de-neurones-et-le-cerveau-de-silicium.html

https://www.youtube.com/watch?v=iwOW83CBWiQ

https://www.journaldunet.fr/management/guide-du-management/1204891-l-intelligence-collective/ https://www.youtube.com/watch?v=VzeOnBRzDik

https://www.britannica.com/science/human-intelligence-psychology

http://theconversation.com/ia-contre-ib-la-guerre-des-intelligences-aura-t-elle-lieu-122898

https://www.frenchweb.fr/pourquoi-lintelligence-humaine-ne-doit-pas-essayer-de-battrelintelligence-artificielle/316081

https://medium.com/nouvelles-intelligences-a-lere-numerique/penser-lacompl%C3%A9mentarit%C3%A9-de-la-machine-%C3%A0-lhomme-43abd923dd0e

https://www.industrie-techno.com/article/l-intelligence-artificielle-nous-fait-changer-decivilisation.43269